Durante una conferenza della Federal Reserve a Washington, il CEO di OpenAI, Sam Altman, ha lanciato un avvertimento senza mezzi termini:

👉 “L’AI ha completamente sconfitto i sistemi di autenticazione vocale.”

Tutti le soluzioni di pagamento che si affidano alla voce, sono in pericolo.

In un’epoca in cui bastano 3 secondi di audio per clonare una voce umana, continuare a usare la biometria vocale per autorizzare transazioni bancarie è da pazzi. Eppure molte banche oltreoceano lo fanno ancora.

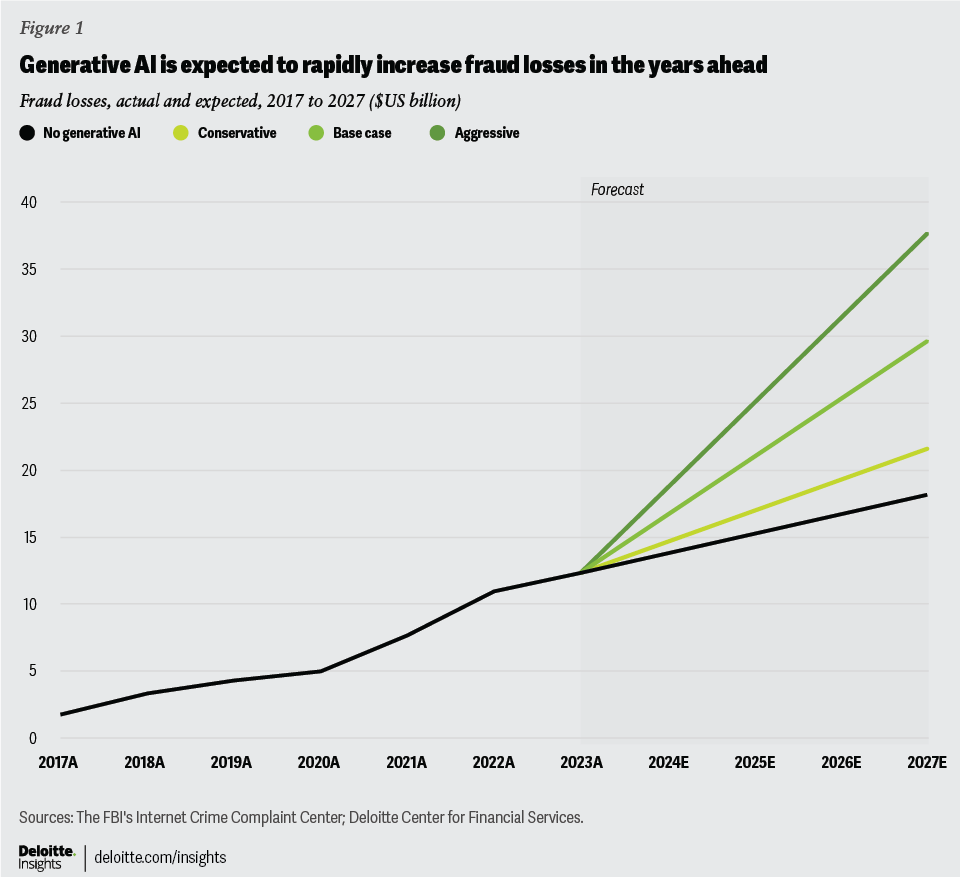

Secondo Deloitte, le frodi alimentate dall’AI cresceranno da 12,3 miliardi di dollari nel 2023 a 40 miliardi nel 2027 (+32% CAGR)

E gli attacchi sofisticati si moltiplicano: come il caso del 2024 da 25,6 milioni di dollari di una società di Hong Kong, truffata via deepfake in videochiamata con “dirigenti” creati dall’AI*.

I principali istituti bancari a stelle e strisce, da JPMorgan a Bank of America, usano ancora la voce per l’accesso agli account. Anche se, secondo BioCatch, il 91% delle banche USA sta riconsiderando l’autenticazione vocale.

E quindi come cambierà l’autenticazione?

Si useranno:

✅ Multifattore evoluto

✅ Biometria contestuale*

✅ Analisi comportamentale

✅ Verifica continua, non statica

Siamo entrati nell’era AI-first.

La fiducia, nel mondo dei pagamenti, va ripensata.

*attacco AI 2024

Nel gennaio 2024, un dipendente del reparto finanza dell’azienda ha partecipato a quella che sembrava una videoconferenza con diversi dirigenti della sede centrale dell’azienda. Tutti i volti e le voci dei partecipanti erano replicati con l’IA — sembravano autentici, ma erano in realtà deepfake generati artificialmente.

Durante la call, al dipendente è stato chiesto di effettuare diversi bonifici per un totale di 25,6 milioni di dollari USA su conti bancari all’estero, presentati come parte di una riservata operazione finanziaria.

Il dipendente, credendo di parlare con i veri executive, ha eseguito i trasferimenti senza sospetti.

*biometria contestuale

La biometria contestuale è una forma avanzata di autenticazione che combina i dati biometrici dell’utente (come voce, volto, impronta digitale) con informazioni contestuali per determinare se un accesso o una transazione è legittimo. Non si basa solo su chi sei, ma anche su come, dove e quando lo fai.

Esempi di biometria digitale:

Accesso biometrico + geolocalizzazione: se provi ad accedere da un paese in cui non sei mai stato, scatta un allarme anche se l’impronta digitale è giusta.

Voce + contesto: anche se la voce corrisponde, il sistema verifica se arriva da un luogo inusuale, un dispositivo sconosciuto o in un orario atipico.

Riconoscimento facciale + comportamento: viene analizzato come tieni il telefono, la velocità con cui digiti, o se il modo in cui interagisci con l’app è coerente con il tuo storico.